Chủ đề matlab gradient: MATLAB gradient là một công cụ quan trọng trong việc tính toán sự thay đổi của hàm số trong không gian nhiều chiều. Bài viết này sẽ cung cấp một cái nhìn toàn diện về gradient trong MATLAB, từ khái niệm cơ bản đến các ứng dụng nâng cao, giúp bạn tối ưu hóa các hàm số và giải quyết bài toán phức tạp hiệu quả hơn.

Mục lục

Gradient trong MATLAB

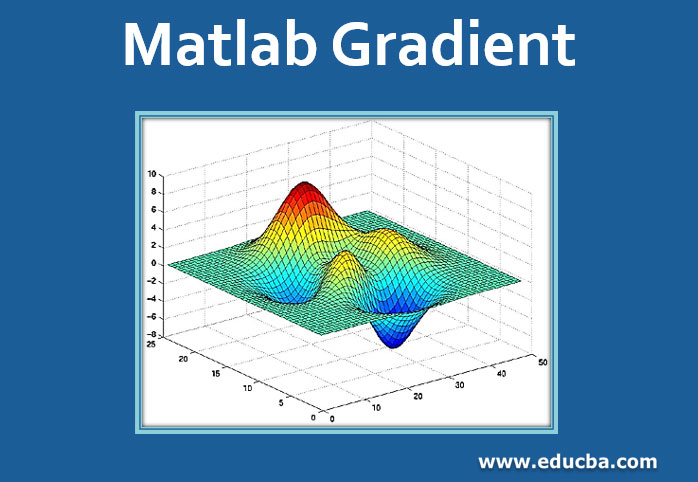

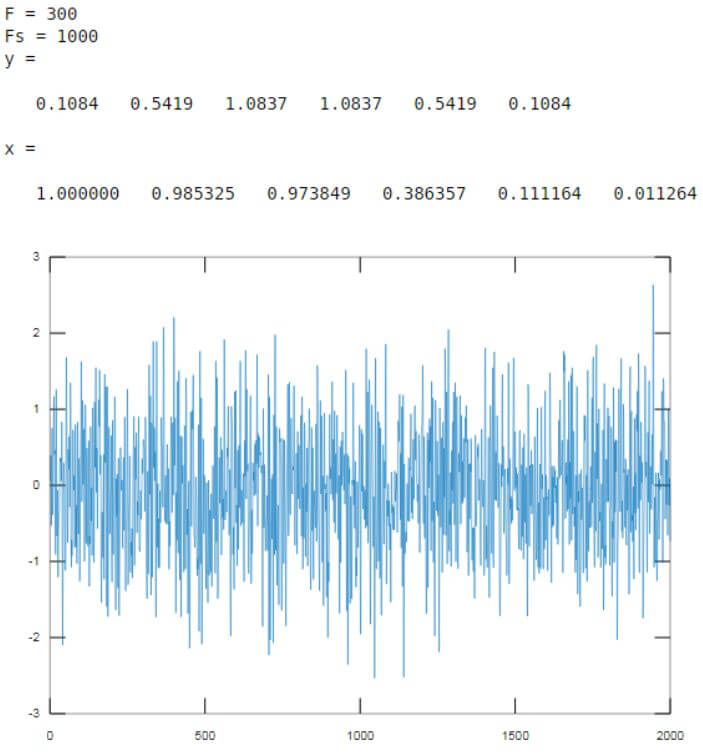

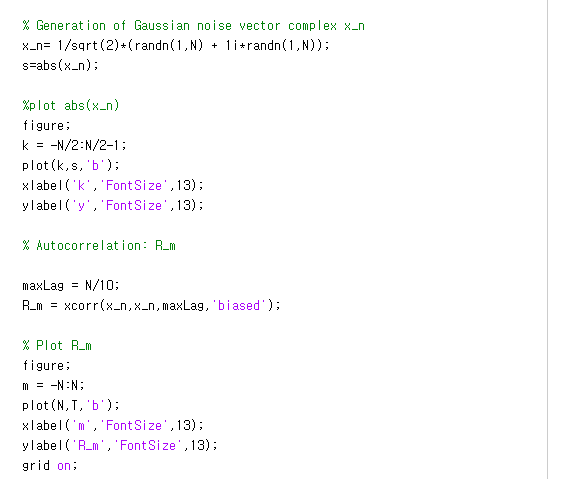

Trong MATLAB, gradient là một khái niệm quan trọng được sử dụng để tính toán độ dốc của một hàm hoặc một mảng giá trị. Điều này đặc biệt hữu ích trong việc xử lý ảnh, mô phỏng toán học và các bài toán kỹ thuật.

Tính gradient của một hàm số

Hàm gradient trong MATLAB có thể được sử dụng để tính toán gradient của một hàm nhiều biến. Gradient của hàm \( f(x, y) \) là một vector có các thành phần là đạo hàm riêng của hàm theo từng biến:

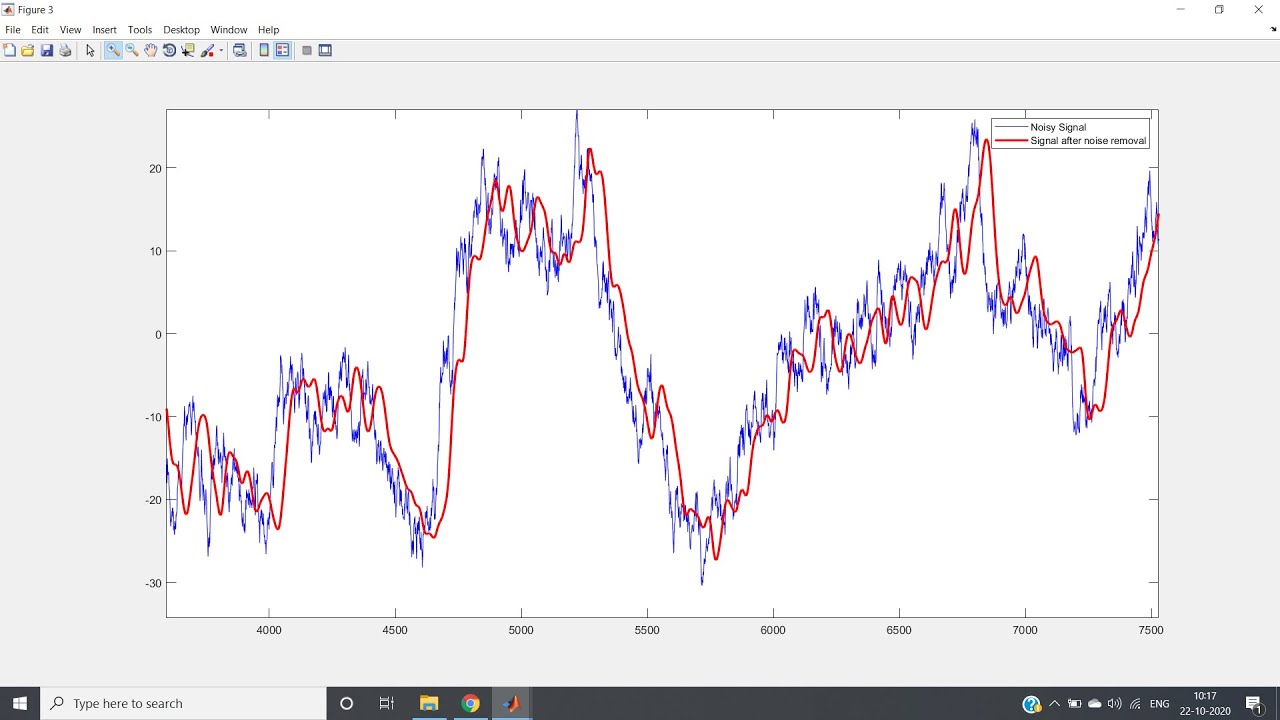

Ứng dụng của gradient trong xử lý ảnh

Khi áp dụng cho một hình ảnh hai chiều, gradient được sử dụng để xác định sự thay đổi về cường độ của ảnh, giúp nhận diện các cạnh và chi tiết trong ảnh. MATLAB cung cấp nhiều phương pháp khác nhau để tính toán gradient trong xử lý ảnh, bao gồm:

- Sobel: Tính toán sự thay đổi cường độ dọc và ngang của ảnh thông qua các toán tử Sobel.

- Prewitt: Phương pháp này sử dụng các toán tử khác biệt để phát hiện cạnh trong ảnh.

- Roberts: Sử dụng toán tử khác biệt theo chiều chéo của ảnh.

Công thức tính gradient trong MATLAB

Để tính gradient của một mảng trong MATLAB, bạn có thể sử dụng cú pháp sau:

G = gradient(F);Ở đây, \( F \) là một mảng đại diện cho các giá trị cần tính gradient, và kết quả \( G \) là một mảng chứa giá trị gradient tương ứng.

Một ví dụ về tính toán gradient

Giả sử bạn có một hàm số \( f(x, y) = x^2 + y^2 \), bạn có thể tính gradient của hàm này tại các điểm khác nhau như sau:

Kết quả gradient sẽ là:

Ứng dụng khác

- Phân tích độ dốc trong các mô hình tài chính và kinh tế.

- Phân tích chuyển động trong các video thông qua gradient của khung hình.

- Dự đoán sự thay đổi nhiệt độ, áp suất trong các bài toán vật lý.

.png)

Khái niệm về Gradient trong MATLAB

Gradient trong MATLAB là một công cụ mạnh mẽ dùng để tính toán độ dốc của một hàm số tại một điểm bất kỳ trong không gian nhiều chiều. Gradient được biểu diễn dưới dạng một vector với các thành phần là đạo hàm riêng theo từng biến số.

- Gradient của một hàm số \(f(x, y)\) được định nghĩa là: \[ \nabla f(x, y) = \left[ \frac{\partial f}{\partial x}, \frac{\partial f}{\partial y} \right] \]

- Trong MATLAB, hàm

gradientđược sử dụng để tính gradient của một ma trận hoặc mảng.

Ví dụ, để tính gradient của một hàm \(z = f(x, y)\), bạn có thể sử dụng mã MATLAB sau:

[X, Y] = meshgrid(-2:0.1:2, -2:0.1:2);

Z = X.^2 + Y.^2;

[FX, FY] = gradient(Z);

Trong đoạn mã trên:

meshgridđược sử dụng để tạo lưới các giá trị cho \(x\) và \(y\).gradienttính toán gradient của hàm \(Z\) theo cả hai biến \(x\) và \(y\).

Kết quả trả về là hai ma trận FX và FY, tương ứng với đạo hàm theo \(x\) và \(y\).

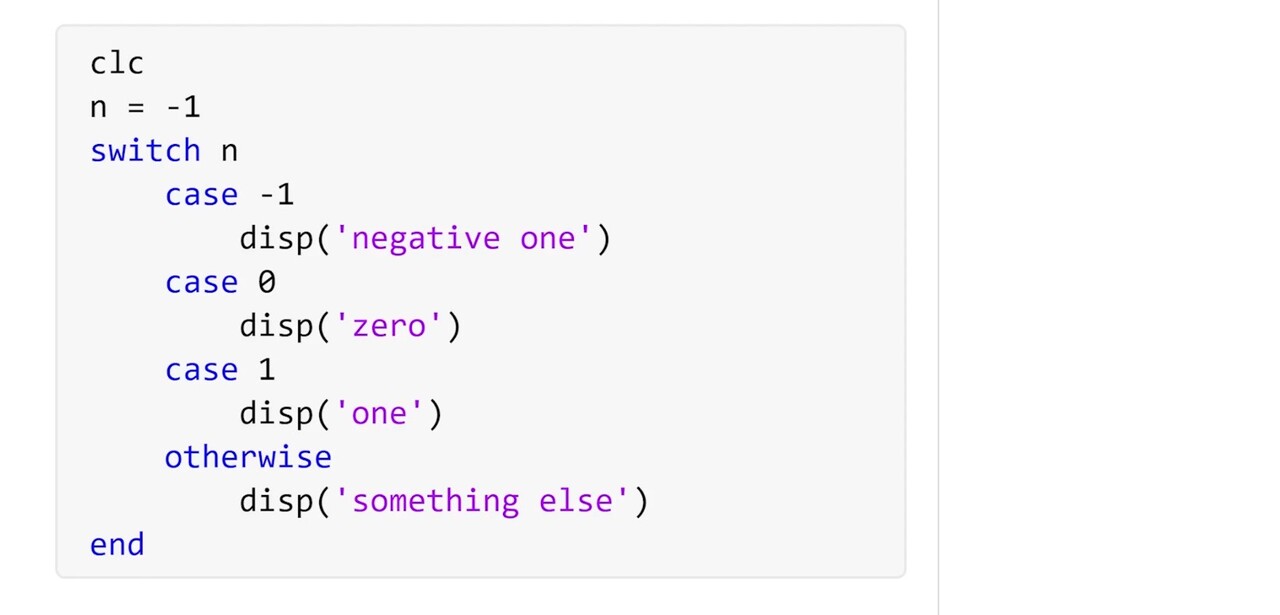

Các phương pháp sử dụng Gradient

Gradient là một công cụ quan trọng được sử dụng trong nhiều lĩnh vực tính toán, đặc biệt là trong tối ưu hóa và học máy. MATLAB cung cấp nhiều cách để tính toán và sử dụng gradient để giải quyết các bài toán phức tạp. Dưới đây là một số phương pháp phổ biến:

- Gradient Số: Đây là phương pháp cơ bản nhất để tính toán gradient. MATLAB cung cấp hàm

gradientđể tính gradient của các mảng số. Phương pháp này sử dụng sự thay đổi nhỏ trong các biến để tính gần đúng đạo hàm riêng của hàm số. Công thức tính gradient của một hàm số \(f(x)\) theo phương pháp này là: \[ \frac{\partial f}{\partial x} \approx \frac{f(x+h) - f(x)}{h} \] - Gradient Ký Hiệu: Phương pháp này sử dụng các công cụ ký hiệu trong MATLAB như Symbolic Math Toolbox để tính gradient của các hàm phức tạp theo cách giải tích. Với phương pháp này, bạn có thể tính gradient chính xác thay vì sử dụng xấp xỉ số.

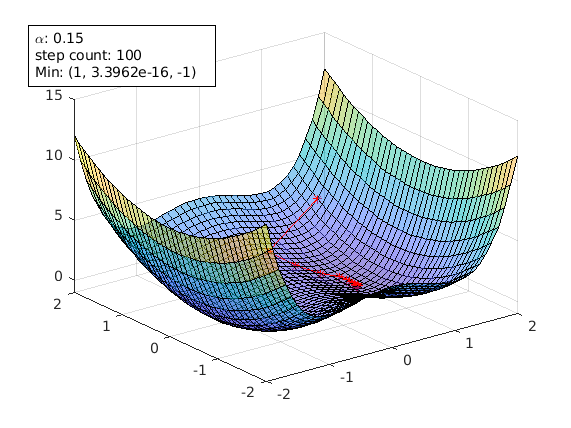

- Gradient Descent: Gradient Descent là một thuật toán tối ưu hóa phổ biến trong học máy và trí tuệ nhân tạo. Mục tiêu của thuật toán này là tìm điểm cực tiểu của một hàm số bằng cách di chuyển theo hướng ngược với gradient của hàm đó. Công thức cập nhật tham số của Gradient Descent là: \[ \theta := \theta - \alpha \nabla f(\theta) \] Trong đó \( \theta \) là tập các tham số cần tối ưu, \( \alpha \) là hệ số học, và \( \nabla f(\theta) \) là gradient của hàm mất mát theo \( \theta \).

- Stochastic Gradient Descent (SGD): Đây là biến thể của Gradient Descent, trong đó gradient được tính trên từng mẫu dữ liệu thay vì toàn bộ tập dữ liệu, giúp giảm thời gian tính toán và tăng tốc độ hội tụ. Phương pháp này thường được sử dụng trong các bài toán học sâu.

Mỗi phương pháp trên đều có ưu và nhược điểm riêng, tùy thuộc vào bài toán và yêu cầu cụ thể mà bạn có thể lựa chọn phương pháp phù hợp nhất.

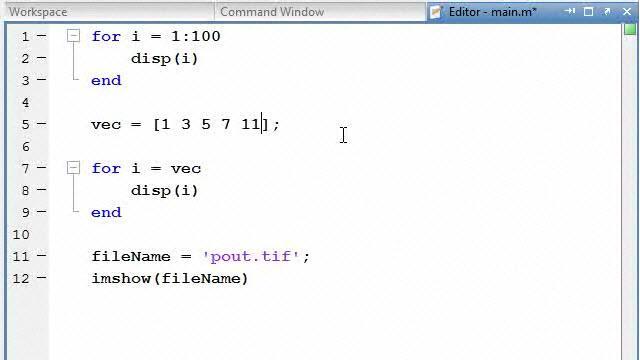

Công cụ và Lệnh MATLAB liên quan

MATLAB cung cấp nhiều công cụ và lệnh mạnh mẽ để hỗ trợ tính toán gradient và các phép toán liên quan. Dưới đây là một số lệnh phổ biến và cách chúng được sử dụng trong các ứng dụng thực tế:

- Lệnh

gradient:Đây là lệnh cơ bản để tính toán gradient của một hàm số hoặc ma trận. Ví dụ:

[X, Y] = meshgrid(-2:0.1:2, -2:0.1:2); Z = X.^2 + Y.^2; [FX, FY] = gradient(Z);Lệnh

gradienttính toán gradient của hàm \(Z = f(x, y)\) và trả về hai ma trận đạo hàm riêng theo \(x\) và \(y\). - Lệnh

diff:Lệnh này được sử dụng để tính toán sự khác biệt giữa các phần tử liên tiếp trong mảng, có thể được sử dụng như một phương pháp xấp xỉ gradient. Ví dụ:

y = [1, 2, 4, 7, 11]; dy = diff(y);Hàm này tính toán sự thay đổi giữa các phần tử trong mảng

y. - Toolbox Symbolic Math:

Công cụ này hỗ trợ tính toán gradient dưới dạng ký hiệu, cho phép tính toán chính xác các đạo hàm riêng của một hàm số. Ví dụ:

syms x y f = x^2 + y^2; gradient(f, [x, y])Kết quả trả về là một vector gradient chứa các đạo hàm của \(f\) theo \(x\) và \(y\).

- Optimization Toolbox:

Toolbox này cung cấp các hàm tối ưu hóa như

fminuncvàfminconđể giải quyết các bài toán tối ưu hóa dựa trên gradient. Các lệnh này sử dụng gradient để tìm giá trị cực tiểu của hàm mục tiêu.

Các công cụ và lệnh trên giúp người dùng MATLAB dễ dàng tính toán và ứng dụng gradient trong nhiều lĩnh vực, từ phân tích dữ liệu cho đến tối ưu hóa các mô hình phức tạp.

Ứng dụng của Gradient trong học máy và trí tuệ nhân tạo

Gradient đóng vai trò rất quan trọng trong học máy (Machine Learning) và trí tuệ nhân tạo (AI). Gradient không chỉ là công cụ tính toán đạo hàm mà còn là yếu tố quyết định trong việc tối ưu hóa các mô hình học máy thông qua các thuật toán học.

- Thuật toán Gradient Descent:

Gradient Descent là thuật toán phổ biến nhất trong học máy, được sử dụng để tối ưu hóa hàm mục tiêu. Bằng cách tính toán gradient của hàm mất mát \(L\) theo các tham số của mô hình, thuật toán này điều chỉnh các tham số để giảm dần giá trị của \(L\) và đạt được kết quả tốt nhất. Công thức cơ bản là:

\[ \theta := \theta - \alpha \cdot \nabla_{\theta}L(\theta) \]Trong đó, \(\theta\) là vector tham số, \(\alpha\) là learning rate, và \(\nabla_{\theta}L(\theta)\) là gradient của hàm mất mát \(L\) với tham số \(\theta\).

- Hồi quy tuyến tính (Linear Regression):

Trong bài toán hồi quy tuyến tính, gradient được sử dụng để tối thiểu hóa hàm mất mát bình phương (mean squared error) bằng cách điều chỉnh các trọng số của mô hình.

- Mạng nơ-ron nhân tạo (Artificial Neural Networks):

Gradient cũng được ứng dụng trong huấn luyện mạng nơ-ron qua thuật toán backpropagation. Thuật toán này sử dụng gradient của hàm mất mát đối với các trọng số của mạng để điều chỉnh chúng, đảm bảo mô hình học chính xác các đặc trưng từ dữ liệu.

- Học sâu (Deep Learning):

Trong các mạng sâu, gradient giúp tối ưu hóa nhiều lớp ẩn để mô hình có thể học được các biểu diễn phức tạp của dữ liệu. Quá trình cập nhật trọng số vẫn sử dụng các thuật toán dựa trên gradient, chẳng hạn như Adam hoặc RMSprop.

- Tối ưu hóa siêu tham số:

Gradient cũng có thể được áp dụng trong việc điều chỉnh các siêu tham số (hyperparameters) trong quá trình huấn luyện mô hình để đạt hiệu quả tối ưu.

Với các ứng dụng rộng rãi này, gradient đóng vai trò quan trọng trong sự phát triển của học máy và trí tuệ nhân tạo, từ các mô hình cơ bản đến những mạng nơ-ron sâu và phức tạp.

Lỗi phổ biến khi tính Gradient và cách khắc phục

Khi sử dụng MATLAB để tính gradient, người dùng thường gặp phải một số lỗi phổ biến. Dưới đây là một số lỗi thường gặp và cách khắc phục từng lỗi một cách chi tiết:

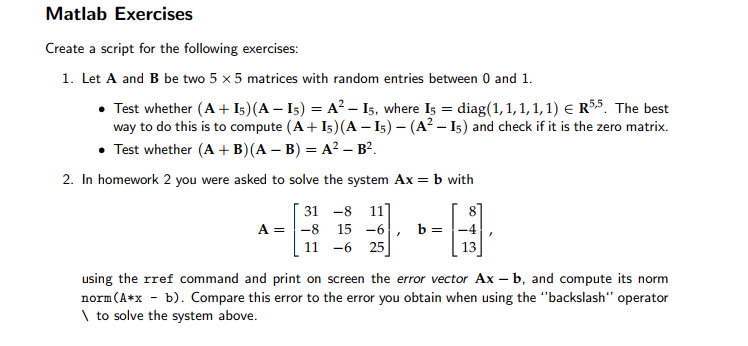

- Lỗi sử dụng kích thước ma trận không phù hợp:

Khi tính gradient, các phép toán ma trận phải có kích thước tương thích. Nếu kích thước không khớp, MATLAB sẽ báo lỗi. Ví dụ, khi thực hiện phép toán gradient của một vector, cần chắc chắn rằng các ma trận được sử dụng đều có kích thước phù hợp.

Cách khắc phục: Sử dụng hàm

\[ [m, n] = size(A) \]sizeđể kiểm tra kích thước của các ma trận trước khi tính toán gradient, đảm bảo kích thước đầu vào khớp với nhau: - Lỗi tính toán với dữ liệu không chính xác:

Nếu dữ liệu đầu vào có giá trị bị lỗi hoặc không hợp lệ, kết quả gradient có thể không chính xác hoặc dẫn đến lỗi tính toán. Điều này thường xảy ra khi các giá trị đầu vào chứa

NaNhoặcInf.Cách khắc phục: Trước khi tính toán gradient, kiểm tra và làm sạch dữ liệu bằng cách loại bỏ hoặc thay thế các giá trị không hợp lệ:

\[ A = A(~isnan(A) \& ~isinf(A)) \] - Lỗi thuật toán hội tụ chậm:

Khi áp dụng thuật toán Gradient Descent trong tối ưu hóa, có thể gặp phải vấn đề thuật toán hội tụ rất chậm, dẫn đến quá trình tính toán kéo dài hoặc không đạt kết quả mong muốn.

Cách khắc phục: Điều chỉnh learning rate (\(\alpha\)) cho phù hợp. Nếu \(\alpha\) quá lớn, thuật toán có thể bỏ qua điểm tối ưu. Nếu quá nhỏ, thuật toán sẽ hội tụ rất chậm. Tối ưu hóa giá trị \(\alpha\) để đạt hiệu suất tốt nhất:

\[ \theta := \theta - \alpha \cdot \nabla_{\theta}L(\theta) \] - Lỗi Gradient biến mất (Vanishing Gradient):

Trong các mô hình học sâu, lỗi gradient biến mất xảy ra khi gradient quá nhỏ và làm chậm quá trình cập nhật các trọng số. Điều này thường gặp trong các mạng nơ-ron sâu.

Cách khắc phục: Sử dụng các kỹ thuật như hàm kích hoạt ReLU thay vì sigmoid để tránh vấn đề gradient biến mất.

- Lỗi gradient không chính xác khi sử dụng hàm tự định nghĩa:

Khi viết các hàm tự định nghĩa, nếu tính toán gradient không chính xác, kết quả sẽ bị sai lệch hoặc dẫn đến lỗi.

Cách khắc phục: Kiểm tra kỹ lưỡng từng bước trong hàm tự định nghĩa và sử dụng các công cụ debug của MATLAB để xác minh tính đúng đắn của các phép tính.

Bằng cách nhận biết và khắc phục các lỗi phổ biến này, người dùng MATLAB có thể đảm bảo quá trình tính toán gradient chính xác và tối ưu hơn.

Blender Room - Cách Tạo Không Gian 3D Tuyệt Đẹp Bằng Blender

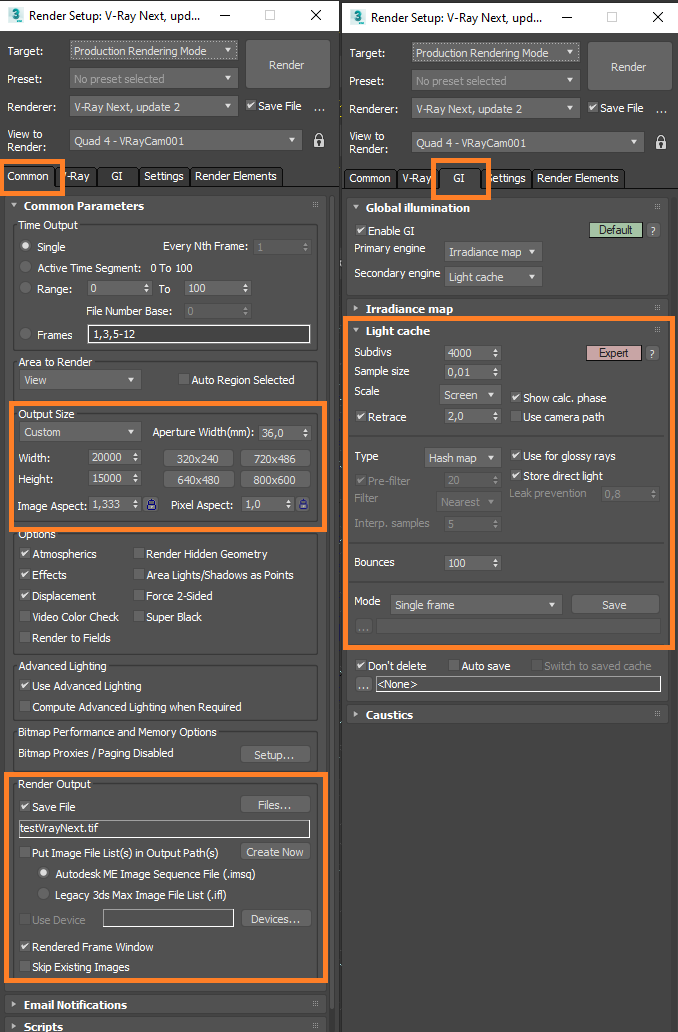

Blender Room - Cách Tạo Không Gian 3D Tuyệt Đẹp Bằng Blender Setting V-Ray 5 Cho 3ds Max: Hướng Dẫn Tối Ưu Hiệu Quả Render

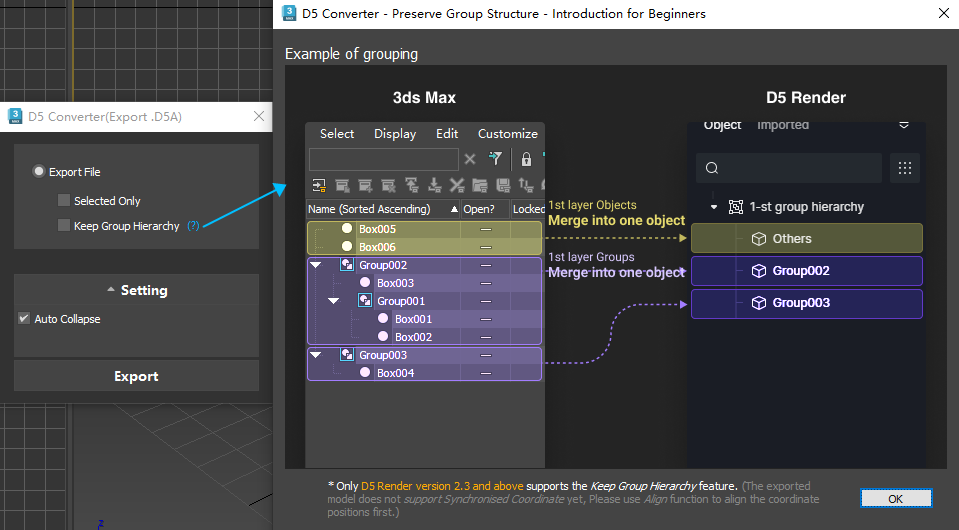

Setting V-Ray 5 Cho 3ds Max: Hướng Dẫn Tối Ưu Hiệu Quả Render D5 Converter 3ds Max: Hướng Dẫn Chi Tiết Và Các Tính Năng Nổi Bật

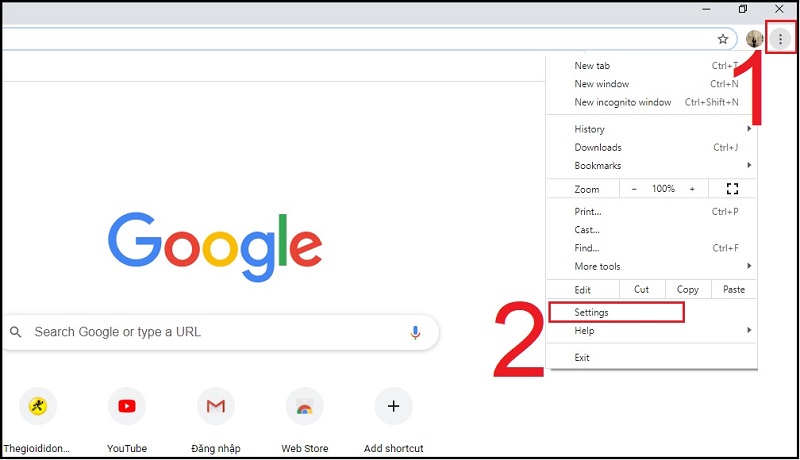

D5 Converter 3ds Max: Hướng Dẫn Chi Tiết Và Các Tính Năng Nổi Bật Xóa Lịch Sử Chrome Trên Máy Tính: Hướng Dẫn Chi Tiết Và Hiệu Quả

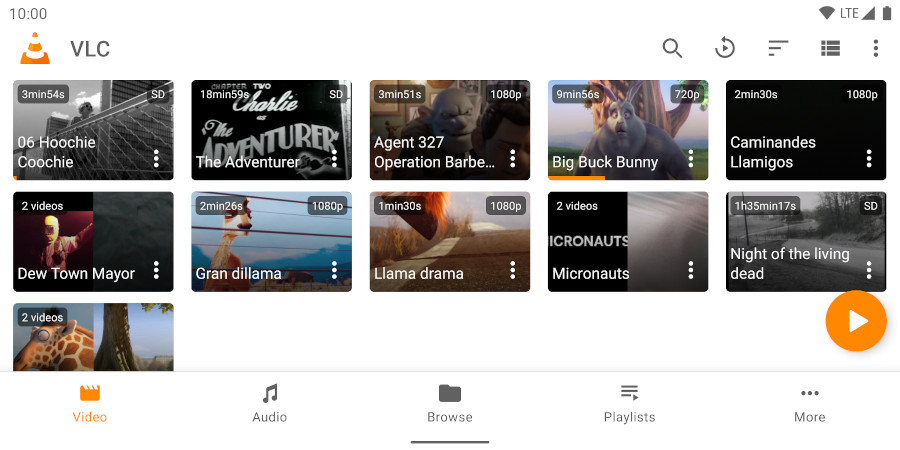

Xóa Lịch Sử Chrome Trên Máy Tính: Hướng Dẫn Chi Tiết Và Hiệu Quả VLC Media Player Android: Hướng Dẫn Chi Tiết và Tính Năng Nổi Bật

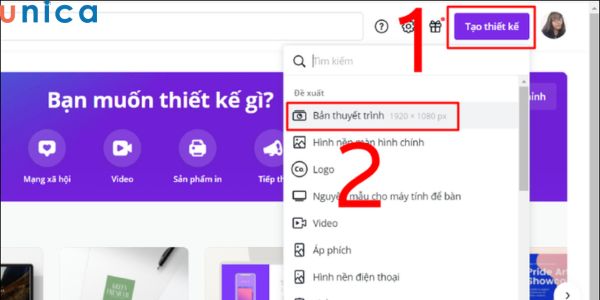

VLC Media Player Android: Hướng Dẫn Chi Tiết và Tính Năng Nổi Bật Chuyển File Canva Sang AI: Hướng Dẫn Nhanh Chóng và Đơn Giản Cho Người Mới Bắt Đầu

Chuyển File Canva Sang AI: Hướng Dẫn Nhanh Chóng và Đơn Giản Cho Người Mới Bắt Đầu Chuyển từ Canva sang PowerPoint - Hướng dẫn chi tiết và hiệu quả

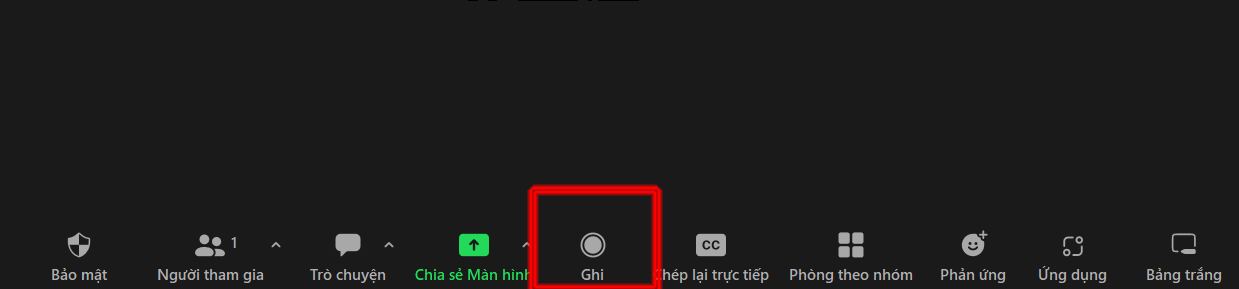

Chuyển từ Canva sang PowerPoint - Hướng dẫn chi tiết và hiệu quả Ghi Âm Zoom Trên Máy Tính: Hướng Dẫn Chi Tiết và Mẹo Hữu Ích

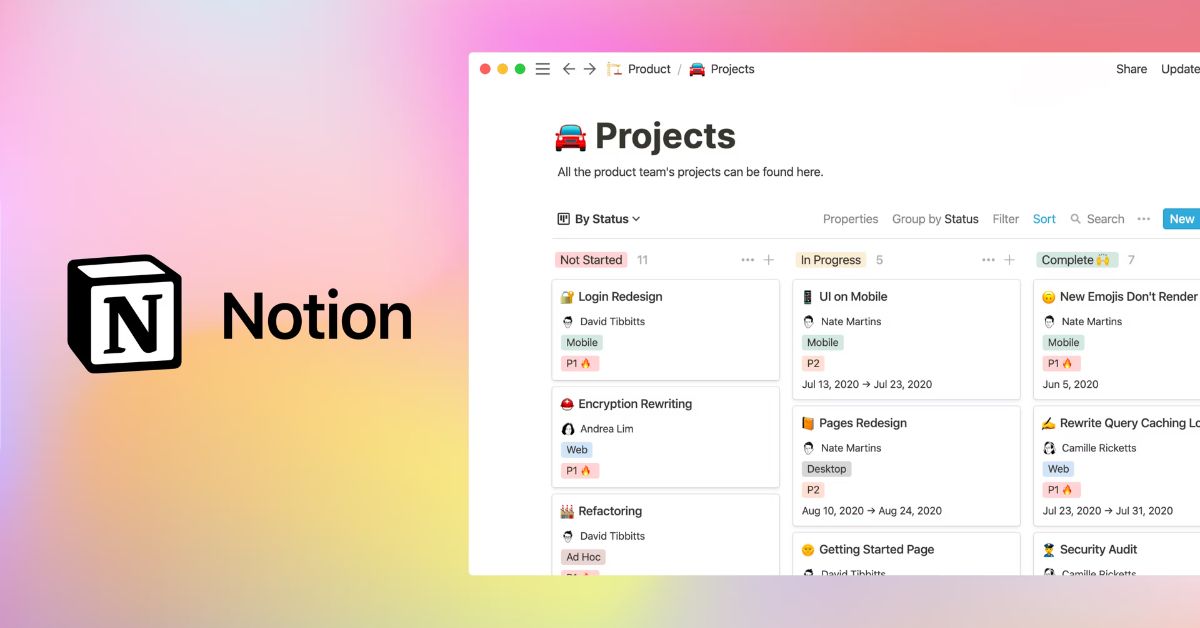

Ghi Âm Zoom Trên Máy Tính: Hướng Dẫn Chi Tiết và Mẹo Hữu Ích "Notion có tiếng Việt không?" - Hướng dẫn thiết lập và lợi ích khi sử dụng

"Notion có tiếng Việt không?" - Hướng dẫn thiết lập và lợi ích khi sử dụng Facebook No Ads XDA - Trải Nghiệm Không Quảng Cáo Đáng Thử

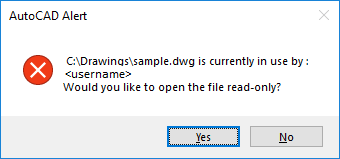

Facebook No Ads XDA - Trải Nghiệm Không Quảng Cáo Đáng Thử Autocad Alert: Giải Pháp Toàn Diện cho Mọi Thông Báo và Lỗi Thường Gặp

Autocad Alert: Giải Pháp Toàn Diện cho Mọi Thông Báo và Lỗi Thường Gặp Ký Hiệu Trên Bản Vẽ AutoCAD: Hướng Dẫn Toàn Diện và Thực Hành

Ký Hiệu Trên Bản Vẽ AutoCAD: Hướng Dẫn Toàn Diện và Thực Hành Tổng hợp lisp phục vụ bóc tách khối lượng xây dựng

Tổng hợp lisp phục vụ bóc tách khối lượng xây dựng Chỉnh kích thước số dim trong cad – cách đơn giản nhất 2024

Chỉnh kích thước số dim trong cad – cách đơn giản nhất 2024